- Přehledy IS

- APS (20)

- BPM - procesní řízení (22)

- Cloud computing (IaaS) (10)

- Cloud computing (SaaS) (33)

- CRM (51)

- DMS/ECM - správa dokumentů (20)

- EAM (17)

- Ekonomické systémy (68)

- ERP (77)

- HRM (27)

- ITSM (6)

- MES (32)

- Řízení výroby (37)

- WMS (30)

- Dodavatelé IT služeb a řešení

- Datová centra (25)

- Dodavatelé CAD/CAM/PLM/BIM... (39)

- Dodavatelé CRM (33)

- Dodavatelé DW-BI (50)

- Dodavatelé ERP (71)

- Informační bezpečnost (50)

- IT řešení pro logistiku (45)

- IT řešení pro stavebnictví (25)

- Řešení pro veřejný a státní sektor (27)

ERP systémy

ERP systémy CRM systémy

CRM systémy Plánování a řízení výroby

Plánování a řízení výroby AI a Business Intelligence

AI a Business Intelligence DMS/ECM - Správa dokumentů

DMS/ECM - Správa dokumentů HRM/HCM - Řízení lidských zdrojů

HRM/HCM - Řízení lidských zdrojů EAM/CMMS - Správa majetku a údržby

EAM/CMMS - Správa majetku a údržby Účetní a ekonomické systémy

Účetní a ekonomické systémy ITSM (ITIL) - Řízení IT

ITSM (ITIL) - Řízení IT Cloud a virtualizace IT

Cloud a virtualizace IT IT Security

IT Security Logistika, řízení skladů, WMS

Logistika, řízení skladů, WMS IT právo

IT právo GIS - geografické informační systémy

GIS - geografické informační systémy Projektové řízení

Projektové řízení Trendy ICT

Trendy ICT E-commerce B2B/B2C

E-commerce B2B/B2C CAD/CAM/CAE/PLM/3D tisk

CAD/CAM/CAE/PLM/3D tisk | |

| Přihlaste se k odběru newsletteru SystemNEWS, který každý týden přináší výběr článků z oblasti podnikové informatiky | |

| |

AI Act: Umělá inteligence jako pomoc nebo hrozba?

Od 2. února 2025 je zakázáno používat systémy umělé inteligence, které představují hrozbu pro člověka. Firmy a úřady teď mají postupně 1,5 roku na to, aby se připravily na požadavky nařízení zvaného AI Act. Podívejme se na několik důležitých aspektů týkajících se tohoto nařízení.

Od 2. února 2025 je zakázáno používat systémy umělé inteligence, které představují hrozbu pro člověka. Firmy a úřady teď mají postupně 1,5 roku na to, aby se připravily na požadavky nařízení zvaného AI Act. Podívejme se na několik důležitých aspektů týkajících se tohoto nařízení.

AI Act je nařízení Evropského parlamentu a Rady (EU) 2024/1689, které vstoupilo v platnost dne 1. srpna 2024. Jedná o první ucelenou právní regulaci umělé inteligence, přestože pokusy vznikaly již dříve v několika dalších ekonomicky vyspělých zemích světa, která mimo jiné přináší i první legální definici umělé inteligence. Nařízení definuje systém umělé inteligence (systém AI) jako „strojový systém navržený tak, aby po zavedení fungoval s různými úrovněmi autonomie, který po zavedení může vykazovat adaptabilitu a který za explicitními nebo implicitními účely z obdržených vstupů odvozuje, jak generovat výstupy, jako jsou predikce, obsah, doporučení nebo rozhodnutí, které mohou ovlivnit fyzická nebo virtuální prostředí.“

Nařízení má za cíl posílit bezpečnost systémů AI, které se dostanou na trh EU. Stanovuje pravidla pro jejich vývoj, uvedení na trh i samotné užívání a na základě míry rizikovosti je rozděluje do několika kategorií, přičemž některé vyloženě zakazuje. V neposlední řadě vymezuje sankce, které lze za porušení pravidel uložit a které mohou spočívat ve varování a stanovení nepeněžních opatření až po uložení pokut v maximální výši 35 milionů EUR či 7 % celosvětového ročního obratu organizace.

Na koho se AI Act vztahuje

AI Act dopadá na celou šíři subjektů – od výrobců až po koncové uživatele umělé inteligence. Prakticky se vztahuje na každého, kdo se daný systém AI chystá uvést na trh v Evropské unii nebo jehož užívání ovlivňuje osoby nacházející se na území EU. V takovém případě totiž nezáleží na místě sídla či podnikání osoby. Jinými slovy dopadá i na subjekty z třetích zemí. Povinnosti vyplývající z nařízení jsou kladeny zejména na poskytovatele, kteří systém AI vyvíjí, nechávají vyvíjet nebo ho implementují do svých provozů, ale vztahují se i na dovozce, distributory, zavádějící subjekty či zplnomocněné zástupce podílející se na implementaci nebo provozu systému AI.

Částečně už platí

AI Act nabyl platnosti 1. 8. 2024, 20 dnů po zveřejnění v Úředním věstníku, a účinnosti bude nabývat postupně. První část nařízení v rozsahu obecných ustanovení a zakázaných systémů AI už k 2. únoru 2025, k 2. srpnu 2025 pak část týkající se povinností pro obecné AI modely a určení dozorových orgánů. Od 2. srpna 2026 bude účinný takřka v celém rozsahu, vyjma zbývajících povinností pro vysoce rizikové systémy umělé inteligence, které se začnou uplatňovat od 2. srpna 2027.

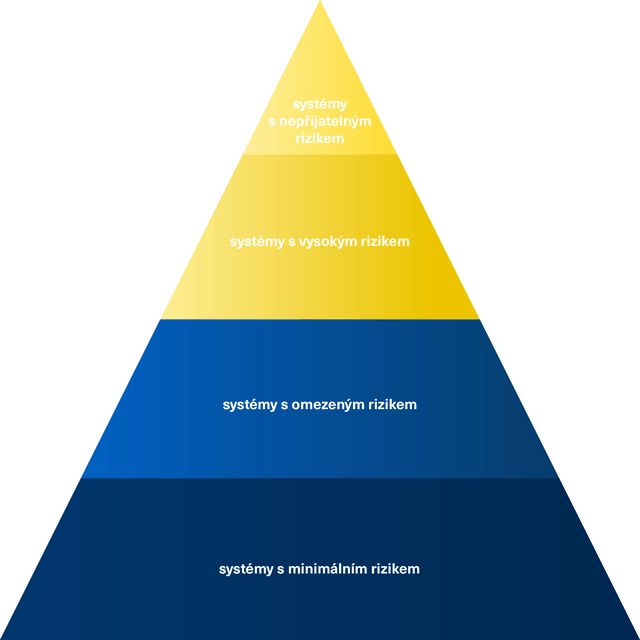

Obr 1. Čtyři kategorie rizikovosti AI systémů podle nařízení Act AI.

Klasifikace rizikovosti AI systémů

Rizika spjatá se systémy AI rozděluje nařízení do čtyř kategorií od nejvyšší po nejnižší stupeň závažnosti. Na jedné straně jsou to systémy s nepřijatelným nebo vysokým rizikem, na straně druhé pak s rizikem omezeným nebo minimálním. Systémy AI s nepřijatelným rizikem jsou jinými slovy zakázané, ty poslední zmiňované jsou v podstatě neregulované, protože obecně jejich užívání nepředstavuje pro uživatele žádné riziko. Nejvíce povinností je spjato se systémy s vysokým rizikem, kde je mimo jiné vyžadováno zavedení systému řízení rizik, vypracování technické dokumentace či povinná registrace před uvedením na trh nebo do provozu.

Rizika využívání AI

Použití systému AI je bezpečné jen do doby, než ho někdo zneužije. Při využívání AI nástrojů je nutné klást důraz zejména na kybernetickou bezpečnost, protože s využíváním umělé intelegence souvisí i řada rizik například v podobě zkreslování reality a předkládání fiktivních záznamů. V tomto ohledu bude ke zneužívání AI docházet - už dnes jsme svědky masivního sdílení falešného audiovizuálního obsahu zejména na sociálních sítích, přičemž mnohdy je těžké upravenou realitu odhalit. Proto je v zájmu každého jedince předvídat a informace si ověřovat. Ne vždy je vše takové, jak působí na první pohled, jakýkoliv údaj se může stát terčem zneužití.

Pak je samozřejmě důležité myslet i na to, jaké informace používáme na vstupu, tedy jaká data do systému AI vkládáme. Zejména v případě veřejně dostupného, otevřeného systému AI je nutné si uvědomit, že do něj nemůžeme vložit jen tak nějaká data. Mohli bychom tím například připravit firmu o know-how a obchodní tajemství. Neměli bychom tam vkládat ani data chráněná autorskými právy, pokud nemáme příslušnou licenci, nebo data obsahující osobní údaje. To samé pak platí u dat na výstupu, kdy je nutné číst podmínky užití daného AI nástroje, ve kterých je upraveno, jakým způsobem je možné vygenerovaný obsah použít. A i v případě takto získaných dat ze systému AI je třeba kriticky zvážit a ověřit jejich správnost. V případně používání AI ve firemním prostředí platí dvojnásob pravidlo, že je nutné zaměstnance neustále vzdělávat a nutit kriticky přemýšlet.

AI u soudu a právnických profesí

S rostoucím počtem AI řešení na trhu se dříve či poději musel k soudu dostat spor plynoucí z užívání AI. V České republice už máme jedno rozhodnutí vydané Městským soudem v Praze z října 2023, ve kterém se řešila otázka autorství ke grafice vytvořené umělou inteligencí. Soud dospěl k názoru, že grafika vytvořená umělou inteligencí není autorským dílem ve smyslu autorského zákona, a je tomu tak z důvodu, že nenaplňuje základní pojmové znaky autorského díla. Nejde totiž o jedinečný výsledek tvůrčí činnosti autora, coby fyzické osoby, a tak na takovou grafiku nedopadá žádná ochrana.

AI se nejen u soudu, ale i u dalších právnických profesí, řeší pochopitelně i v jiných souvislostech, a to z pohledu jejího využití při každodenních činnostech. AI již nyní pomáhá se sepisováním jednoduchých návrhů smluv, revizí textů či rešeršemi judikatury. V neposlední řadě AI může pomoci i soudcům a úředníkům při přípravě podkladů pro rozhodnutí. Co se však týče řešení složitějších právních otázek či vydání samotných rozhodnutí, toho AI ještě v dohledné době schopna nebude. Při takových činnostech je nutné zapojit i lidský nadhled a empatii, kterou AI postrádá.

V Evropě bezpečně

V současné době pozorujeme, že většina významných softwarových společností prvky AI do svých systémů zapojuje. Kromě nákladově efektivnějšího provozu to především uživatelům umožňuje zjednodušit a zrychlit jejich práci, což je v dnešní hektické době více než žádoucí. S ohledem na to, jak se technologie rychle vyvíjejí a jaká rizika s sebou přinášejí, je tedy právní regulace umělé inteligence na místě. V tomto ohledu Evropská unie stihla reagovat včas. Nyní zde máme ucelený právní rámec, který je předpokladem korektního chování jedinců i korporací, ať už při vyvíjení nebo používání AI nástrojů. Díky AI Actu se v EU nedostaneme do situace, kdy nás například na ulicích budou zachycovat kamery s prvky AI. To ocení jistě každý z nás.

|

Simona Kobylková Autorka článku je právnička a odbornice na AI ve společnosti GORDIC. |

| Po | Út | St | Čt | Pá | So | Ne |

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 18.5. | Konference ISSS 2026 |

| 19.5. | TechEd |

| 19.5. | Webinář FLEXI IT | Novinky & Tipy & Triky 2021... |

| 21.5. | Online konference Kyber bez keců |

| 21.5. | ManageEngine Meetup 2026 Bratislava |

Formulář pro přidání akce

| 4.6. | Setkání zákazníků a partnerů ABIA CZ & dFlex 2026... |